こんにちは、技術研究所のウエサマです。

人工知能分野における日本の先進的な取り組みや、研究成果を知るため人工知能学会の全国大会(第30回)に参加してきましたので、いくつか紹介したいと思います。

尚、今回の会場は北九州の小倉。

小倉は「焼うどん」、「アーケード商店街」発症の地だそうです。そして世界遺産 官営八幡製鐵所旧本事務所がありますね。

あと初日から気になっていた、駅前にあるシロヤベーカリー。ここのサニーパン、アノン、オムレットはとっても美味しかったです^^

人工知能学会全国大会(第30回)

第30回となる今回の全国大会は、参加者数1,500名、発表数約700件と、AI冬の時代から参加者が約3倍となり、関心や期待の高さが伺えます。

2日目に行われた公開イベント「コンピュータ囲碁は人間に迫れるか」では、日本の囲碁プログラムZENと武宮洋行(六段)とのハンディ戦(2子局)の対戦も行われました。

開始早々ZENが”プロ棋士を目指していたら、碁はあきらめて国帰れって言われる”ほどのミスをするシーンもありましたが、その後持ち返し最後は勝利を納めていました。

AlphaGoとは違い従来のモンテカルロ法による局面評価、大規模シミュレーションで対戦に臨んだとの事です。

参考:第二次ブームの頃と第30回の参加人数

| 年 | 回 | 参加人数 | 発表数 | 備考 |

| 2016 | 第30回 | 1,500 | 700 | 開催日:2016年6月6日(月)~9日(木) 会 場:北九州国際会議場、ほか URL:http://www.ai-gakkai.or.jp/jsai2016/ |

| 1986 | 第1回 | 1,139 | 127 | (参考) 1980年~ 第2次AIブーム - エキスパートシステム - 第5世代コンピュータプロジェクト(1981) - AIが産業へ進出 1995年~ AI冬の時代へ・・・ |

| 1987 | 第2回 | 1,235 | 137 | |

| 1988 | 第3回 | 1,205 | 194 | |

| 1989 | 第4回 | 1,104 | 169 | |

| 1990 | 第5回 | 936 | 179 | |

| 1991 | 第6回 | 936 | 181 | |

| 1992 | 第7回 | 746 | 189 |

今回、Deep Learning関連で自然言語処理に関する研究を主に聴講してきましたが、他のテーマも含め大変興味深い発表がたくさんありました。

その中から次の4件について順に紹介します。(最後はオススメです)

・Deep Learning技術をベースとした異常画像検出/菊田 遥平(トーマツ デロイトアナリティクス) ほか

・逆畳み込みニューラルネットワークを用いた輪郭検出/味曽野 雅史(東京大学工学部システム創成学科) ほか

・ディベート人工知能における議題文の構造化と関連情報獲得/佐藤 美沙(日立製作所 基礎研究センタ) ほか

・マルチエージェントによるDeep Learningの提案/黒滝 紘生(東京大学工学系研究科技術経営戦略学専攻) ほか

Deep Learning技術をベースとした異常画像検出

菊田 遥平(トーマツ デロイトアナリティクス) ほか

https://kaigi.org/jsai/webprogram/2016/pdf/664.pdf

不動産ポータルサイトSUUMOに掲載する画像に不適切な画像が無いか、Faster R-CNNをベースとした検出方法を構築。

提案手法は、Region-based Convolutional Neural Network(R-CNN) とその中間層から抽出したfeature map を用い、大量画像からの異常画像を検出するというものでした。

検出したい異常画像:

・人が写り込んでいる

・無関係な画像が写っている

・遮蔽物で物件が十分に写っていない

・未完成な物件(工事中)

ちなみに人が写り込んでいると判定した時のスコアが、十分に高ければ自動でモザイク処理を行ってくれるとのこと。

開発はcaffe、python、AWS GPUインスタンス(g2.2xlarge)

学習はCPUで24秒/1枚、GPUの場合 0.56秒/枚となり、1万枚/日(1.5時間)とした場合、GPUインスタンスの使用料は7,500円程度と試算されていました。ちなみに画像は640 x 640 pixとのことです。

AWSのGPUインスタンスは速度も速く、複製や作ったり、壊したりと構成も楽なため、自前でハードを準備するよりクラウドサービスを使った方が良いかもしれません。(Azureやsoftlayerなど、他のサービスも試してみたいですね)

逆畳み込みニューラルネットワークを用いた輪郭検出

味曽野 雅史(東京大学工学部システム創成学科) ほか

https://kaigi.org/jsai/webprogram/2016/pdf/763.pdf

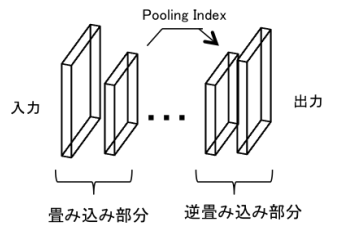

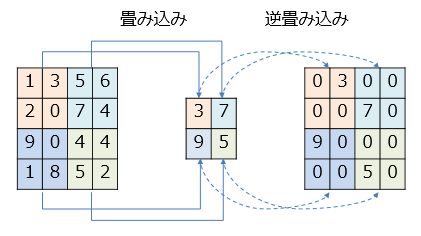

自然画像の中から物体の領域を分ける線を抽出する”輪郭検出問題”に関する研究で、従来手法よりも若干綺麗な輪郭抽出が実現したという発表でした。

この新しい提案手法は2015年時点で輪郭検出の性能が最も高かったHEDと比較した検証が行われており、新しい手法は従来手法に比べて論理的にも納得感のあるものでした。

この従来手法は、Full Convolution Networkとなっており、プーリング層で小さくした特徴量を、最後は画像サイズまで戻す(拡大)するため輪郭がぼやけてしまう。という課題がありました。

これに対して新しい提案手法は、逆畳み込み層を入れる事で輪郭を最後の画像サイズに戻しても維持するよう工夫されています。

ディベート人工知能における議題文の構造化と関連情報獲得

佐藤 美沙(日立製作所 基礎研究センタ) ほか

https://kaigi.org/jsai/webprogram/2016/pdf/982.pdf

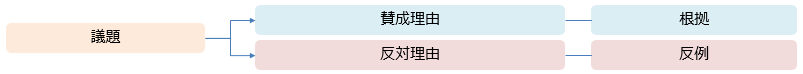

与えられた議題に対して賛成または、反対の理由、根拠を提示するシステムで、組織内の意思決定をより合理的なものにすることを目指している研究の発表でした。

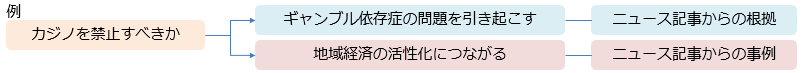

下図に示すように議題に対して、賛成、反対それぞれの立場で意見を提示してくれますので、意思決定の際は根拠を含め非常に参考になると思います。

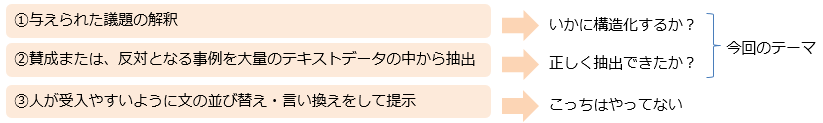

このディベート人工知能は次のステップで実装していくとされており、今回は①議題解釈、②事例抽出までの評価を実施。

実験は議題をディベートデータベースから取得し、賛成/反対の根拠を行うコーパスとして”Gigaword”を採用しています。

|

結果 |

|

・ルールで適切に構造化できた議題に関しては85%以上は根拠を見つける事ができている。 ・回答を生成するために用いるデータセットと照らし合わせて、議題文の構造化を行うのが有効である。 |

|

結果 |

|

・同義語展開 ・今回の議題解釈は初歩的で、現実の意思決定の場での議題解釈には、より複雑なモデルが必要である。 ・適切に構造化できない議題が17%あり。(どのように構造化されるべきか不明確) |

コメント:言語は英語を対象としており、日本語による実装はまだ先のようです。また、対象とするコーパスが持つ構造を理解したうえで、議題なり質問文などを適切に構造化していく事が重要と感じましたが、こうしたコーパスにおける知識、概念の記述にも複数の手法があるため自動的にルールを作れればと思いました。

マルチエージェントによるDeep Learningの提案

黒滝 紘生(東京大学工学系研究科技術経営戦略学専攻) ほか

https://kaigi.org/jsai/webprogram/2016/pdf/953.pdf

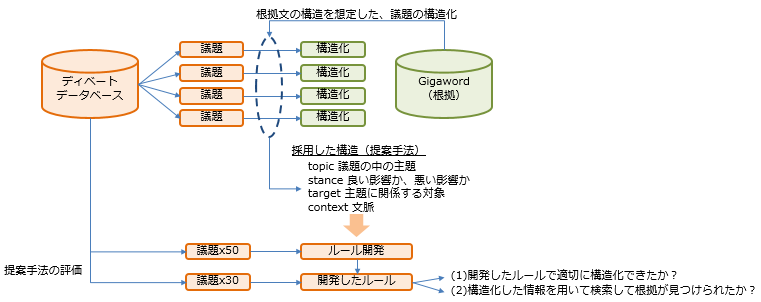

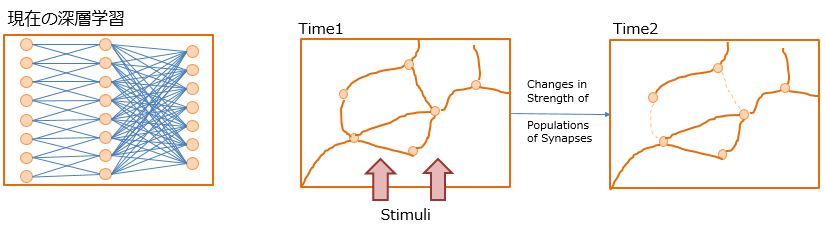

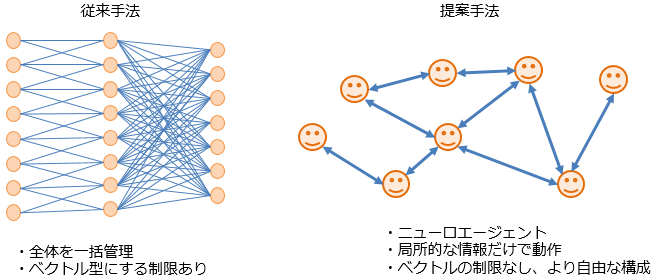

研究にあたるうえで抱いている問題意識として「ネットワーク構成のスケーラビリティ」、「ベクトル行列構成と生物学的妥当性」というのをあげ、

解決法としてマルチエージェントシステムの考え方を導入したマルチエージェント深層学習というのを新たな手法として提案していました。

そして10層くらいなら、まだ書けるが100層、1,000層となると、もう人間では書けない・・・と説明がありました。

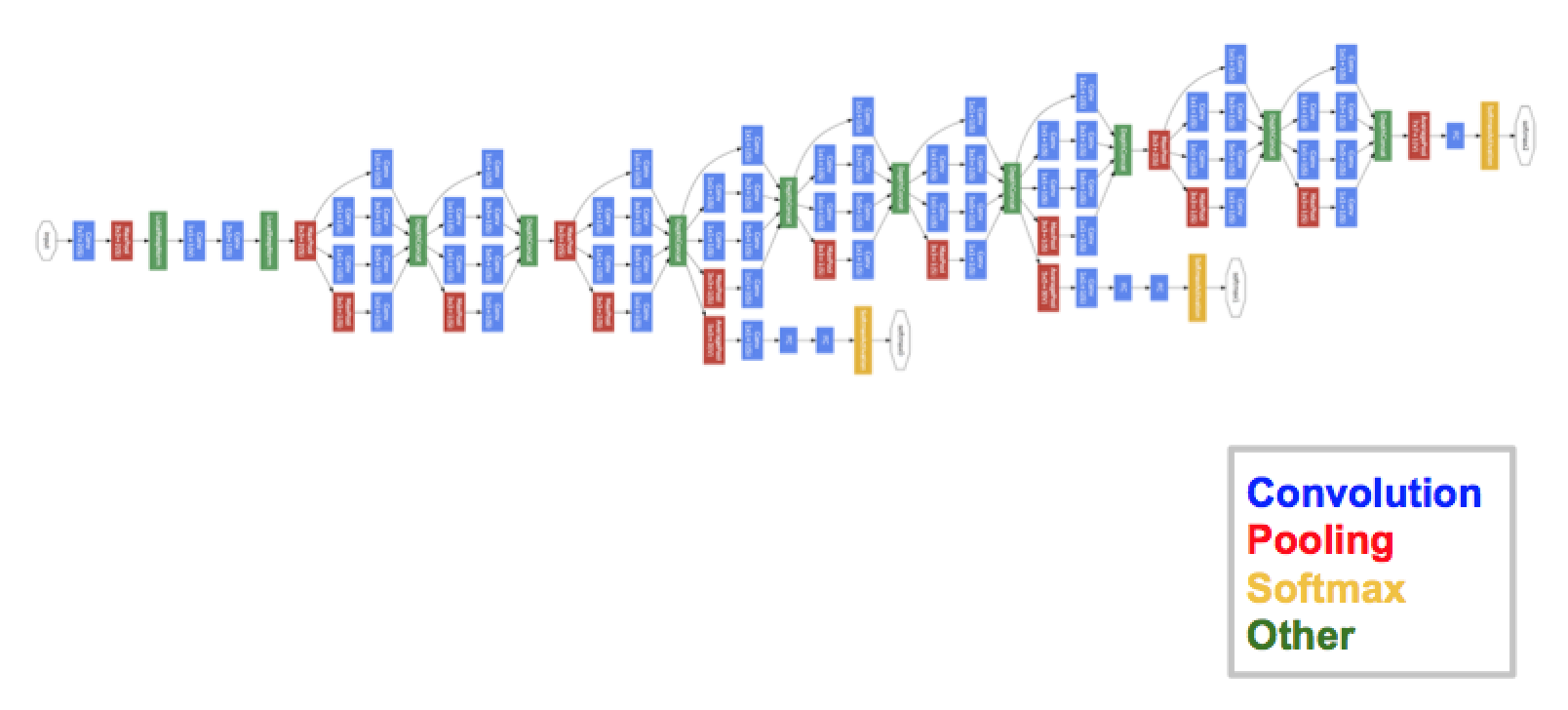

例えばこれ、ILSVRC2014にて誤り率6.7%で優勝したGoogle LeNetのネットワーク構成。

提案手法:マルチエージェント深層学習

・複雑な深層学習モデルを、マルチエージェントの枠組みで再編成する

・各特徴量(下図の円の1つ)に対応して、独立行動するエージェントを一つ割当てる

・スケーラビティ、行列ベクトル積の制約などの問題を解決できる。

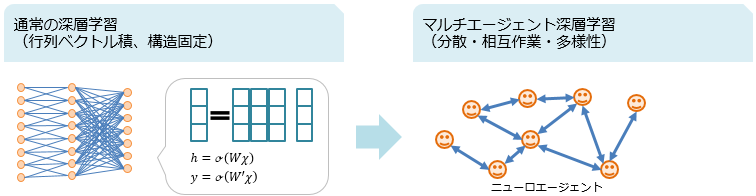

実装は新しいネットワークモデルを設計するのではなく、既に良い性能を出す、先行研究のモデルのうち論理的な同一性を持つものを選択し、少しずつ改良を行うとのこと、尚、採用したのは深層学習モデルの一種であるStacked Denoiseing Autoencoder。

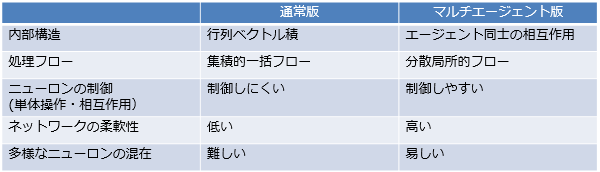

提案手法:通常の深層学習との違い

実験:MNISTデータによる従来手法と提案法の比較

・学習回数、率は従来法とほぼ一致して収束

・テストデータでの平均エラー率、従来法とほぼ一致

まとめ:本研究の成果

・マルチエージェントとして、深層学習を再構成する方法を提案した。

・特に、提案手法の枠組みで、SDAをマルチエージェント的に再構成できることを、理論・実験の両面から示した。

これは、深層学習の性能を保ったモデルを作るために、重要。

(他にSDAをベースに確率的にエッジを削減した手法も提案されていました)

・提案手法は、スケーラビリティ、モデルの柔軟性の向上

生物学的な妥当性、などから深層学習の発展を助けていると考えられる。

コメント:この発表は、とても興味深かったです。

先に示した、Google LeNetのニューラルネットワークをcaffeで書こうと思ったら100layerくらい定義しないと実装できません。

層の数、厚みを変えようものなら定義に矛盾を起こし破たんしそうです(笑)

そして、設計したニューラルネットはスケールしませんし、脳の神経細胞を工学的に表現しているとはいえ、細胞がレイヤーによって区切られた集積的な構造を持つとも考え難いですよね。ひょっとしら2層目のノードが3層目を飛び越して4層目のノードと接続するという事があって良いのかもしれません。

これらノードがマルチエージェントを構成するならば、各ノードは効用の総和を最大化できるよう動作すると思いますので、もっと動的で自由なネットワークになるのかなぁと感じましたね。

今後とても期待しています。